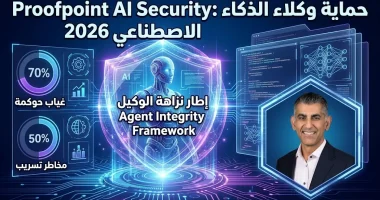

أعلنت شركة «بروف بوينت» (Proofpoint)، الرائدة عالمياً في حلول الأمن السيبراني، اليوم الأربعاء 18 مارس 2026، عن إطلاق منصتها الأحدث Proofpoint AI Security، يأتي هذا الحل في وقت حساس لتلبية احتياجات المؤسسات في تأمين تقنيات الذكاء الاصطناعي، عبر دمج تحليل مقاصد الاستخدام مع نقاط تحكم متقدمة تضمن سلامة العمليات الرقمية وحماية البيانات الحساسة.

| الميزة / الإحصائية | التفاصيل (تحديث مارس 2026) |

|---|---|

| اسم المنصة الجديدة | Proofpoint AI Security |

| إطار العمل المعتمد | Agent Integrity Framework (إطار نزاهة الوكيل) |

| مراحل نضج الحوكمة | 5 مراحل (من الاكتشاف إلى فرض السياسات) |

| نسبة المؤسسات التي تفتقر للحوكمة | 70% وفقاً لتقارير Acuvity الحديثة |

| مخاطر تسريب البيانات | 50% من المنظمات مهددة خلال الـ 12 شهراً القادمة |

آلية التنفيذ: إطار عمل خماسي المراحل لضمان النزاهة

يستند الحل الجديد الذي كُشف عنه اليوم إلى إطار عمل مبتكر يُعرف بـ Agent Integrity Framework، والذي يضع ضوابط صارمة لتشغيل وكلاء الذكاء الاصطناعي، وتعتمد المنصة نموذج نضج يتألف من 5 مراحل أساسية، تبدأ من مرحلة “الاكتشاف” وتنتهي بـ “فرض السياسات” المباشرة أثناء التشغيل، مما يضمن توافق سلوك الذكاء الاصطناعي مع الأهداف التشغيلية للمنشأة ومنع أي انحرافات برمجية غير مصرح بها.

تحذيرات من مخاطر “حقن الأوامر” وغياب الحوكمة في 2026

تأتي هذه الخطوة في وقت بدأت تظهر فيه تهديدات سيبرانية فعلية ومعقدة، حيث رصد الخبراء اليوم عدة مخاطر رئيسية:

- تصعيد الصلاحيات: محاولات اختراق الأنظمة عبر استغلال ثغرات الذكاء الاصطناعي للوصول إلى بيانات حساسة.

- هجمات حقن الأوامر (Prompt Injection): تنفيذ عمليات برمجية خبيثة دون تفاعل بشري مباشر، وبسرعة تفوق قدرات الإشراف التقليدية.

- فجوة الحوكمة: كشفت أحدث أبحاث مؤسسة Acuvity أن 70% من المنظمات لا تزال تفتقر إلى سياسات حوكمة فعالة للذكاء الاصطناعي، بينما تتوقع 50% منها التعرض لحوادث تسريب بيانات مرتبطة بهذه التقنيات قبل حلول عام 2027.

رؤية القيادة: تطور الأمن لمواكبة الذكاء الاصطناعي

أكد سوميت دهوان، الرئيس التنفيذي لشركة “بروف بوينت”، أن الذكاء الاصطناعي بات ركيزة أساسية في بيئات العمل الحديثة عام 2026، وهو ما يفرض تطوراً موازياً في المنظومات الأمنية، وأوضح دهوان قائلاً: “يعمل الموظفون ووكلاء الذكاء الاصطناعي اليوم جنباً إلى جنب، وكلاهما عرضة للتلاعب أو تنفيذ إجراءات قد تنحرف عن الغرض المحدد لها، لذا تبرز الحاجة لتأمين هذه التفاعلات بدقة متناهية”.

النتائج المتوقعة للمؤسسات والجهات السعودية

تتيح المنصة الجديدة للمؤسسات والجهات الحكومية والخاصة، لا سيما في المملكة العربية السعودية التي تشهد طفرة في تبني تقنيات الذكاء الاصطناعي، القدرة على:

- الكشف الشامل عن كافة أدوات الذكاء الاصطناعي المستخدمة، سواء كانت معتمدة رسمياً أو ما يعرف بـ “الذكاء الاصطناعي الظلي” (Shadow AI).

- تقييم سلوك الوكلاء الرقميين والتأكد من مطابقتها للمقاصد التشغيلية الأصلية والأنظمة المحلية.

- سد الفجوة الأمنية التي تعجز الأدوات التقليدية عن مراقبتها فيما يتعلق بحركة وصلاحيات الذكاء الاصطناعي داخل الشبكة.

أسئلة الشارع السعودي حول تأمين الذكاء الاصطناعي

هل يمكن للشركات المتوسطة في المملكة الاستفادة من هذا الحل؟الحل موجه للمؤسسات بكافة أحجامها التي تعتمد على وكلاء الذكاء الاصطناعي في عملياتها اليومية، حيث يوفر مراحل نضج تبدأ من الاكتشاف البسيط وصولاً إلى الحماية الكاملة.

ما هو الخطر الأكبر الذي يواجه الموظف السعودي عند استخدام الذكاء الاصطناعي اليوم؟الخطر يكمن في “حقن الأوامر” الذي قد يؤدي لتسريب بيانات العمل دون قصد، وهو ما تعمل منصة Proofpoint AI Security على رصده ومنعه فوراً.

- شركة بروف بوينت (Proofpoint)

- مؤسسة Acuvity للأبحاث التقنية